从真实世界图像中推断一个主体的情绪类别,机器不仅需要考虑主体本身的情绪线索(例如人脸表情和肢体语言等),也要考虑主体所在上下文的情绪线索(例如周围的人、物体和场所等)。在此类上下文感知的情绪识别中,如何提取情绪线索和处理线索关系是具有挑战性的。长期以来研究者们通常采用两阶段框架:首先使用现成的检测器定位主体,然后通过后期融合的主体-上下文特征进行情绪分类。然而,这种复杂的范式存在两个问题:一是训练阶段定位和分类脱节,二是主体-上下文元素之间细粒度交互有限。

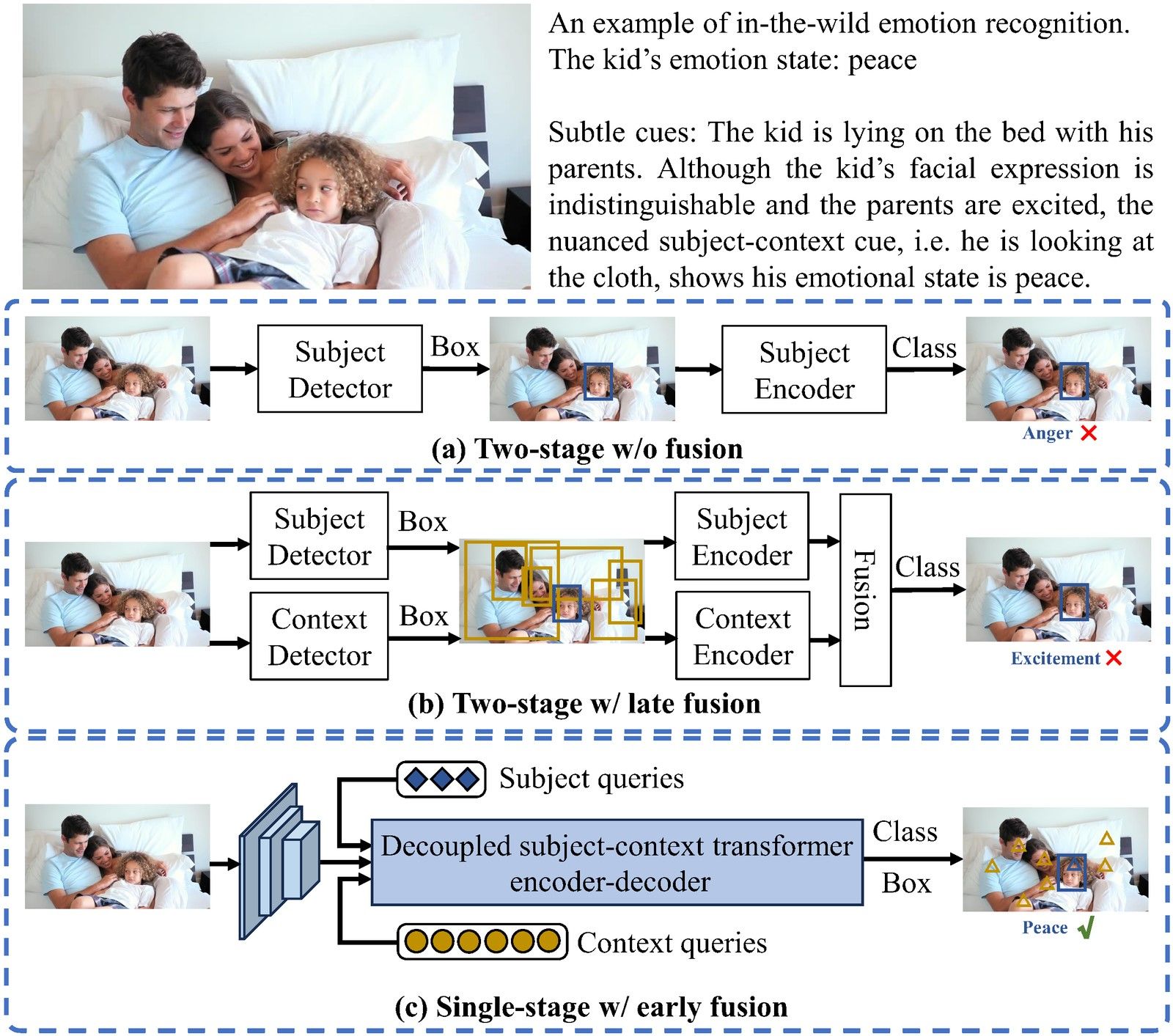

图1. DSCT与当前方法的比较

为解决以上问题,深圳技术大学大数据与互联网学院彭小江教授(IEEE高级会员,智能科学与技术系主任)带领多模态智能感知与生成技术团队(MIPS)联合中国电信人工智能研究院(TeleAI)、香港大学等单位,提出了单阶段主体-上下文解耦变换器(DSCT),为提升情绪识别的精度和效率给出了全新的范式,实现主体定位和情绪分类的同时进行。首先,DSCT不再将定位和分类的训练隔离开,而是联合利用边界框和情绪信号作为监督来单阶段训练,丰富主体的特征学习。此外,DSCT以“解耦后融合”的方式来促进主体-上下文线索之间的交互。DSCT通过不同的建模和监督方式,来解耦查询对象:主体和上下文查询对象;两类对象在DSCT的各层中逐渐融合,在此过程中,空间和语义关系被利用和聚合以提升效果。

图2. DSCT框架

DSCT方法能提升机器人的社交智能,使其能够更自然地理解并响应用户的情绪和意图,进而促进人与机器人之间的高效交流、合作与互动。同时,该方法还使机器人在复杂场景中能够提供心理健康支持,包括同理心的回应、识别痛苦迹象以及实施适当的干预措施。

研究成果被中国计算机学会(CCF)推荐的A类国际学术会议ACM Multimedia 2024录用,我校彭小江教授为通讯作者,其科研助理李新鹏为第一作者。

论文地址:https://arxiv.org/abs/2404.17205

代码地址:https://github.com/Sampson-Lee/DSCT

稿件来源:大数据与互联网学院